أثبتت دراسة جديدة لجامعة ستانفورد stanford أن تكنولوجيا الذكاء الاصطناعي قد تنمو بسرعة لكنها تفشل في توفير الشفافية الكافية

وقد ذكر المقال الأخير المنشور في هذا الصدد مدى خطورة الأمر لأن صناع السياسات بحاجة إلى التوجيه إذا كانوا يرغبون في مكافحة القضايا المرتبطة بضعف التنظيم.

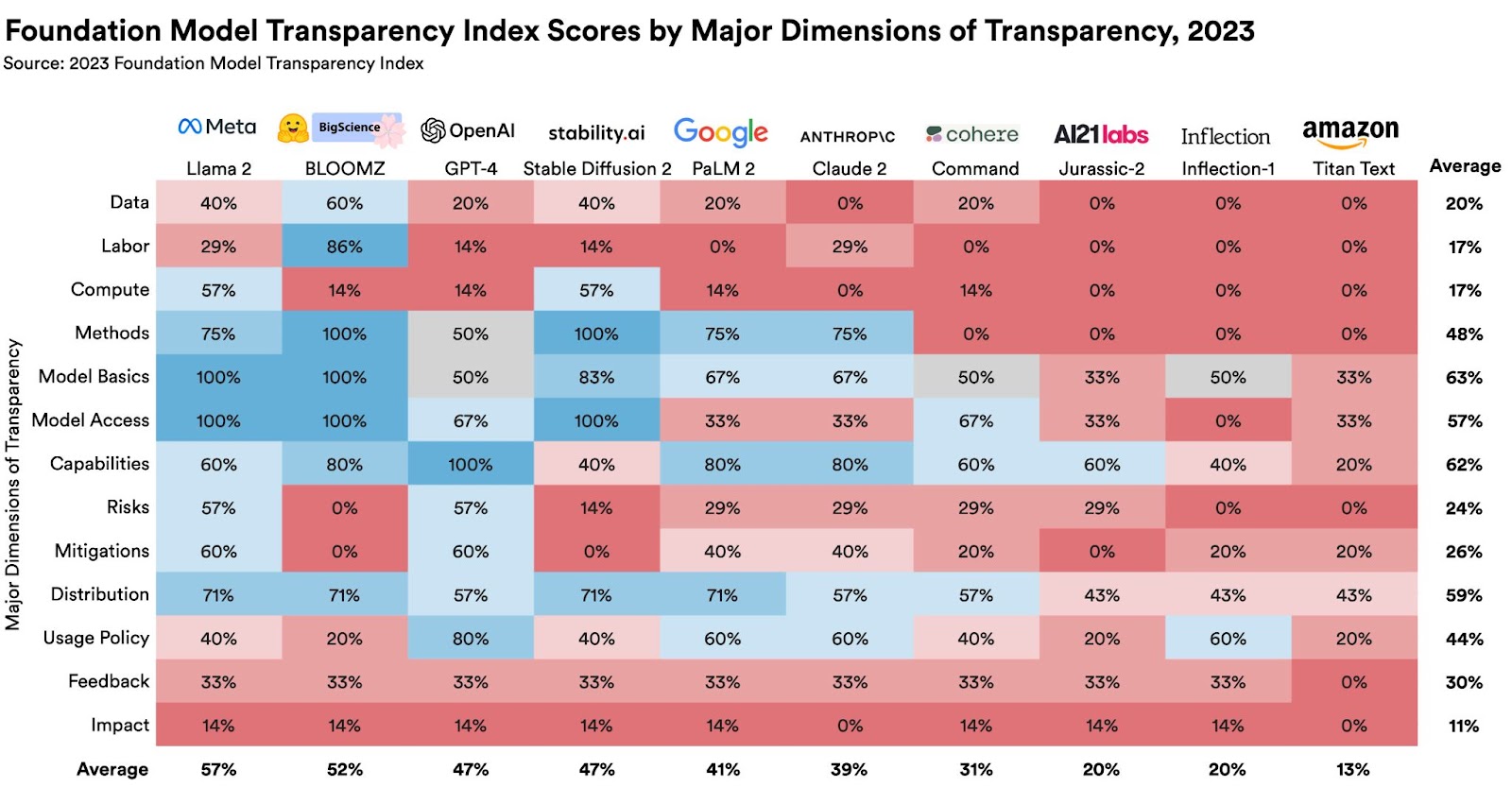

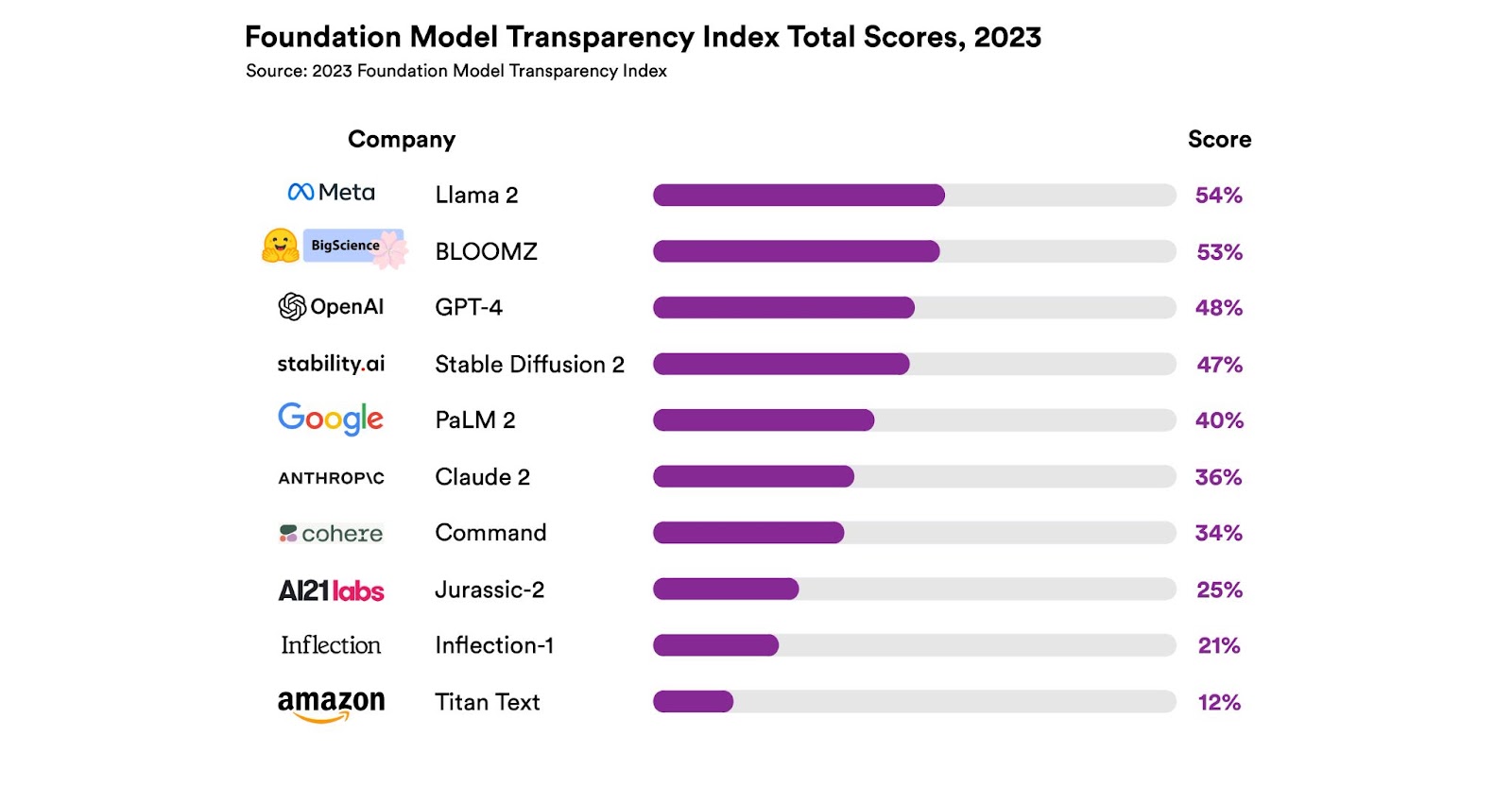

وفقًا لباحثين من جامعة ستانفورد stanford، صنف مؤشر جديد يسمى Foundation Model Transparency أفضل 10 شركات رائدة في مجال الذكاء الاصطناعي في هذا الصدد، وكان من المثير للاهتمام رؤية النتائج الإجمالية.

وبقدر ما يتعلق الأمر بمن جاء في المقدمة، فقد تمكنت Llama 2 من تحقيق 54%. هذا الأخير هو أحد منتجات Meta وتم طرحه في شهر يوليو.

جاء GPT-4 وهو أحد منتجات OpenAI في المركز الثالث بنسبة 48%. وفي الوقت نفسه، احتل برنامج PaLM 2 من Google المركز الخامس بنسبة 40% فقط، وهو أعلى بقليل من Anthropic الذي سجل 36%.

وأوضح أحد الباحثين الذي يُدعى ريشي بوماساني كيف تحتاج الشركات إلى السعي لتحقيق درجة تتراوح بين 80 إلى 100%.

وفقًا للتقرير، ذكر المؤلفون كيف أن قلة الشفافية تجعل الأمور أكثر صعوبة. وبهذه الطريقة، يكافح صناع السياسات من أجل وضع السياسات الصحيحة لتنظيم مثل هذه التكنولوجيا القوية.

وبنفس الطريقة، فإنه يجعل الأمور أكثر صعوبة بالنسبة للشركات لفهم ما إذا كان يمكن الاعتماد على هذا النوع من التكنولوجيا للتطبيقات أو لأغراض الدراسة أو حتى لفهم العيوب التي تمتلكها نماذج الذكاء الاصطناعي هذه.

وتذكر أن الافتقار إلى الشفافية يعني أن المنظمين سيواجهون صعوبات في طرح الاستفسارات الصحيحة، وسينسون اتخاذ الإجراء المناسب في هذا المجال.

نعلم جميعًا كيف أن وصول الذكاء الاصطناعي قد جاء بضجة كبيرة وأن الضجيج حقيقي بالتأكيد. ولكن يمكن أن يطغى على ذلك بفضل القضية الرئيسية المتمثلة في انعدام الشفافية. وفي نهاية المطاف، سوف يواجه المنظمون صعوبات في طرح الاستفسارات الصحيحة، وبالتالي سوف يعانون من أجل السيطرة على مثل هذه المجالات أيضًا.

اليوم، أدى وصول الذكاء الاصطناعي إلى إثارة دهشة كبيرة فيما يتعلق بما يمكن توقعه وكيف يمكن للتكنولوجيا أن تؤثر على جميع أفراد المجتمع.

علاوة على ذلك، تسلط دراسة ستانفورد هذه الضوء أيضًا على عدم قيام أي شركة بتقديم بيانات حول عدد المستخدمين الذين يعتمدون على نموذج الذكاء الاصطناعي أو عبر أي موقع جغرافي يمكن استخدامه فيه.

تفشل غالبية شركات الذكاء الاصطناعي في الكشف عن كمية البيانات المحمية بحقوق الطبع والنشر المستخدمة لمثل هذه النماذج كما أكد الباحثون مؤخرًا.

وتذكر أن الشفافية تشكل أحد الاعتبارات الرئيسية عند وضع السياسات، وأن أغلبية أولئك الذين يترأسون هذا المجال في الاتحاد الأوروبي يدركون ذلك. وينطبق الشيء نفسه على مناطق مثل كندا والولايات المتحدة والصين والمملكة المتحدة.

ولكن من المؤكد أن الاتحاد الأوروبي يمضي قدما، بكل قوة، فيما يتعلق بتنظيم الذكاء الاصطناعي، ويأمل في وضع القوانين المناسبة بحلول نهاية هذا العام.

via: hai.stanford.edu